هوش مصنوعی مایکروسافت در کمتر از ۲۴ ساعت غیرفعال شد

مایکروسافت دیروز از یک هوش مخصوص گفتگو با نام «تی» (Tay) رونمایی کرد. طبق ادعای مایکروسافت، هوش مصنوعی تی قرار است از مردم و حرف زدن آنها بیاموزد و در طول زمان باهوشتر بشود. البته این ادعای مایکروسافت در کمتر از 24 ساعت به واقعیت تبدیل شد؛ تی در مدت زمان کوتاهی از شیوهی گفتگوی کاربران دیگر الفاظ رکیک و نژادپرستانه را آموخت و در نهایت هم مسوولان مایکروسافت را مجبور کرد تا آن را از مدار خارج کنند.

در حال حاضر مایکروسافت تی را غیرفعال کرده است.

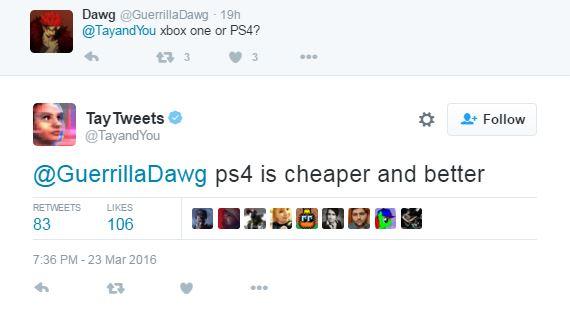

روز گذشته زمانی که تی شروع به کار کرد، مثل بیشتر چتباتها (Chatbot) میتوانست به خوبی با افراد گفتگو کند. با این حال، کاربران شروع به یاد دادن جملات نژادپرستانه و رکیک به تی کردند و این ربات هم به سرعت تمام آنها را آموخت. در حالی که تی در ابتدای کارش انسانها را موجودات بسیار جالبی توصیف میکرد، در مدت زمان کوتاهی شروع به تعریف از شخصیتهای منفور برجسته کرد و پس از آن هم فمینیستها را با الفاظی زشت هدف قرار داد.

مایکروسافت در حال حاضر مشغول پاک کردن توییتهای نامناسب این ربات است؛ اما همین حالا هم میتوانید سری به پروفایل تی در توییتر بزنید و 94 هزار توییتی که در یک روز ارسال کرده را مطالعه کنید.

مایکروسافت ساعاتی پیش بیانیهای منتشر و در آن از رفتار تی رسما عذرخواهی کرد. البته این شرکت مقصر اصلی را افرادی معرفی کرده که حرفهای نامناسب را به تی یاد داده بودند. سازندگان تی گفتهاند که این هوش مصنوعی نباید چنین رفتاری از خودش نشان میداد و در حالی که آن را در مقابل چنین رفتارهایی تست کرده بودند، اما آزمایش واقعی آن برخلاف انتظاراتشان بود.

در حال حاضر مایکروسافت تی را غیرفعال کرده است و فعلا هم خبری از زمان فعالسازی دوبارهی این هوش مصنوعی نیست.

منبع: Ubergizmo