هوش مصنوعی لاما چیست و چرا اهمیت دارد؟

هوش مصنوعی لاما عضوی از یک خانواده از مدلهای زبان بزرگ (LLM: Large Language Model) و مدلهای چندوجهی بزرگ (LMM: Large Multimodal Models) از شرکت متا است. لاما اساساً پاسخ با واکنش متا، شرکت مادر فیسبوک، به اوپن ای آی و محصولش چت جی پی تی و همچنین به جمینای هوش مصنوعی گوگل است.

اما برنامه هوش مصنوعی لاما یک تفاوت کلیدی با سایر هوش مصنوعیها دارد و آن هم اینکه همه مدلهای لاما در قالب یک هوش مصنوعی رایگان برای تقریباً هرکسی قابل استفاده است؛ چه برای افرادی که از آن در تحقیق و پژوهش استفاده میکنند، چه برای افرادی که مقاصد تجاری دارند. این نکته برای بسیاریها اهمیت زیادی پیدا کرده و باعث شده که مدلهای مختلف لاما بین توسعهدهندگان AI بسیار محبوب شوند. حال بیایید باهم ببینیم هوش مصنوعی لاما چیست؟

هوش مصنوعی لاما چیست؟

llama 3 چیست؟

چگونه لاما را امتحان کنیم؟

سایت هوش مصنوعی لاما

دانلود هوش مصنوعی لاما

Llama 3 چگونه کار میکند و چه تفاوتی با Llama 2 دارد؟

ویژگیهای جدید Llama 3

مقایسه لاما با GPT، جمینای و سایر مدلهای AI

چرا هوش مصنوعی لاما اهمیت دارد؟

آینده هوش مصنوعی لاما

مارک زاکربرگ و آینده لاما

هوش مصنوعی لاما چیست؟

همانطور که گفته شد لاما یک خانواده از LLMها مانند GPT از اوپنای و جمینای گوگل است. به طور ساده لاما هم یک هوش مصنوعی مثل دیگر هوش مصنوعیهاست، اما برای درک تفاوت آن با سایرین باید اندکی به عمق مفهوم هوش مصنوعی و مدلهایی که لاما از آن استفاده میکند برویم.

در حالی که برخی تفاوتهای فنی بین لاما و دیگر LLMها و LMMها وجود دارد، همه این مدلهای AI به طور اساسی به یک روش یکسان توسعه یافته و کار میکنند؛ آنها از همان معماری ترنسفورمر و ایدههای توسعه مانند پیشآموزش و تنظیم دقیق اطلاعات استفاده میکنند. بیایید با یک مثال مساله را روشنتر کنیم.

وقتی شما یک متن ورودی به مدل لامای متنی ارائه میدهید، این مدل سعی میکند محتملترین متنِ بعدی را با استفاده از سیستم شبکه عصبی خود پیشبینی کند؛ شبکه عصبی در واقع الگوریتمی است که با میلیاردها متغیر یا «پارامتر» که بر اساس مغز انسان مدلسازی شده است، کار میکند. بنابراین لاما با استفاده از این الگوریتم و با اختصاص دادن وزنهای مختلف به تمام پارامترهای متفاوت و همچنین افزودن تعداد اندکی متغیرهای تصادفی، میتواند پاسخهای بسیار انسانی تولید کند.

در حال حاضر، نسخه ۳.۱ لاما برای برخی مدلها و نسخه ۳.۲ آن برای دیگر مدلها در دسترس است، هرچند که سیستم شمارهگذاری اهمیت زیادی ندارد و در نهایت همه مدلهای استفاده شده بخشی از لاما ۳ هستند. اما Llama 3 چیست؟

llama 3 چیست؟

پیش از اینکه به توضیح دقیق اینکه llama 3 چیست، بپردازیم، بیایید انواع نسخههای ارائه شده آن را با هم مرور کنیم. متا در ژوئیه ۲۰۲۴ شش مدل لاما ۳.۱ را منتشر کرد:

- Llama 3.1 8B

- Llama 3.1 8B-Instruct

- Llama 3.1 70B

- Llama 3.1 70B-Instruct

- Llama 3.1 405B

- Llama 3.1 405B-Instruct

و در سپتامبر ۲۰۲۴ هشت مدل لاما ۳.۲ را منتشر کرد:

- Llama 3.2 1B

- Llama 3.2 1B-Instruct

- Llama 3.2 3B

- Llama 3.2 3B-Instruct

- Llama 3.2 11B-Vision

- Llama 3.2 11B-Vision-Instruct

- Llama 3.2 90B-Vision

- Llama 3.2 90B-Vision-Instruct

مدلهای Llama 3.2 1B و Llama 3.2 3B برای استفاده روی دستگاهها و رابط کاربریشان طراحی شدهاند. این به این معنی است که آنها به اندازه کافی کوچک و کم حجم هستند تا بتوانند مستقیماً در گوشیهای هوشمند و لپتاپهای مدرن اجرا شوند و نیازی نیست دادهها را از دستگاه خود به یک فضای ابری (claud) منتقل کنید. این مدلها میتوانند هم پردازش را تسریع کنند و هم از حریم خصوصی کاربران به دلیل بینیازی از claud بیشتر حفاظت کنند.

مدلهای Llama 3.1 8B و Llama 3.2 11B-Vision هم دارای همان قابلیتهای تولید متن در مدلها قبلی هستند، اما Llama 3.2 11B-Vision توانایی استدلال بصری (visual reasoning) هم دارد؛ این نوع استدلال یعنی لاما در این نسخه میتواند تصاویر را شناسایی کند، اطلاعات درون آنها از جمله اطلاعات درون نمودارها و گرافها را استخراج کند، دستنوشتههای انسانی را بخواند و بهطور کلی با دادههای بصری کار کند.

در مورد Llama 3.1 70B و Llama 3.2 90B-Vision وضعیت مشابهی وجود دارد؛ متا آنها را طوری طراحی کرده است که برنامه نویسان میتوانند بهطور مستقیم مدلهای لاما ۳.۱ را با مدلهای لاما ۳.۲ جایگزین کنند تا قابلیتهای بصری را به برنامههای خود اضافه کنند، بدون اینکه نیاز به تغییر دستی داشته باشند.

چند ماه پیش گفته شد که مدل پیشرفته Llama 3.1 405B دارای ۴۰۵ میلیارد پارامتر است. این مدل در حالی که متا هنوز قابلیتهای بصری را به آن اضافه نکرده است، یکی از قدرتمندترین LLMهای باز موجود است.

چگونه لاما را امتحان کنیم؟

یکی از راههایی که میتوانید لاما را امتحان کنید به وسیله دستیار متا AI است، دستیار AI متا که در فیسبوک، مسنجر، اینستاگرام و واتساپ ساخته شده است، از لاما ۳ استفاده میکند. این دستیار هوش مصنوعی برای اکثر پرسشها، از مدل Llama 3.2 90B-Vision استفاده میکند. اما اگر میخواهید از هوش مصنوعی لاما برای ورودیهای چالشبرانگیزتر استفاده کنید، باید به سراغ نسخه وب متا بروید.

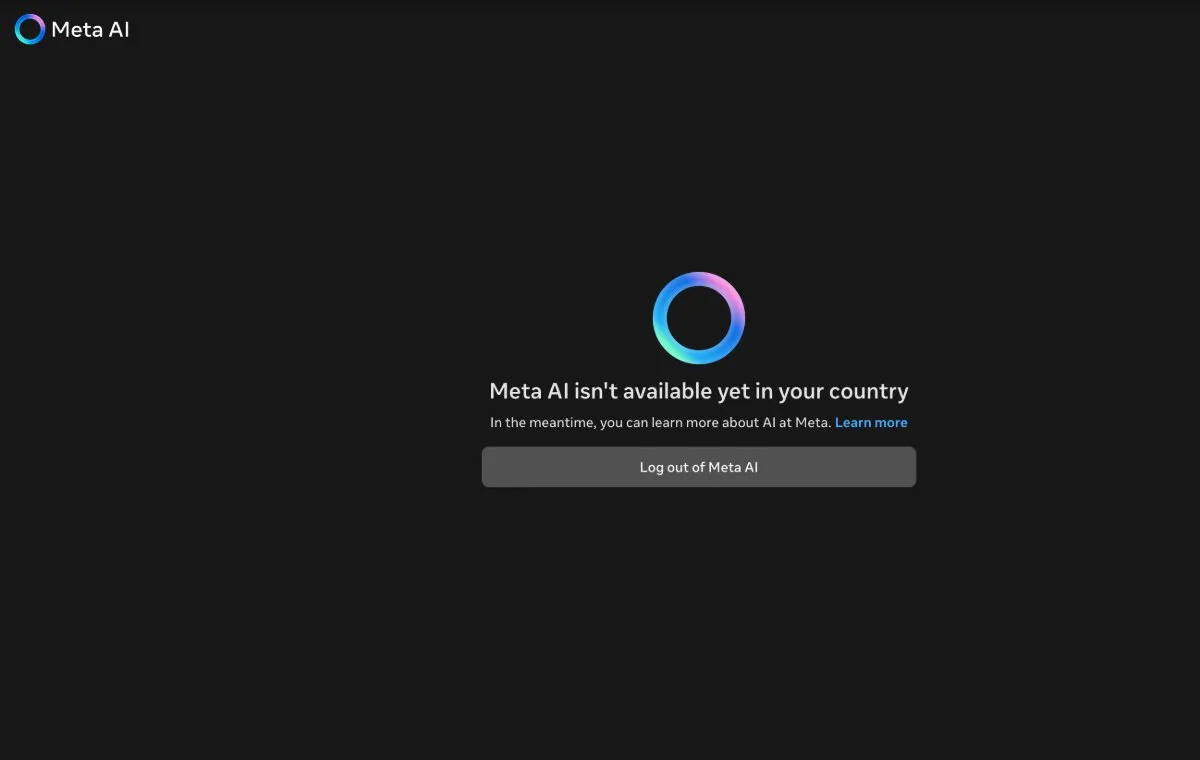

سایت هوش مصنوعی لاما

برای استفاده از نسخه وب لاما باید به سایت هوش مصنوعی لاما به آدرس meta.ai بروید. اما اگر در یکی از کشورهای معدودی که شرکت متا، هوش مصنوعی متا را در آنها راهاندازی کرده، نباشید نمیتوانید وارد آن شوید.

به جای آن اگر میخواهید از مدلهای Llama 3.1 70B-Instruct و Llama 3.2 11B-Vision استفاده کنید، میتوانید از HuggingChat، چتبات نمونه AI HuggingSpace، استفاده کنید. راه دیگر هم این است که IP خود را به IP کشورهایی که متا ای آی در آن راهاندازی شده است، تغییر دهید.

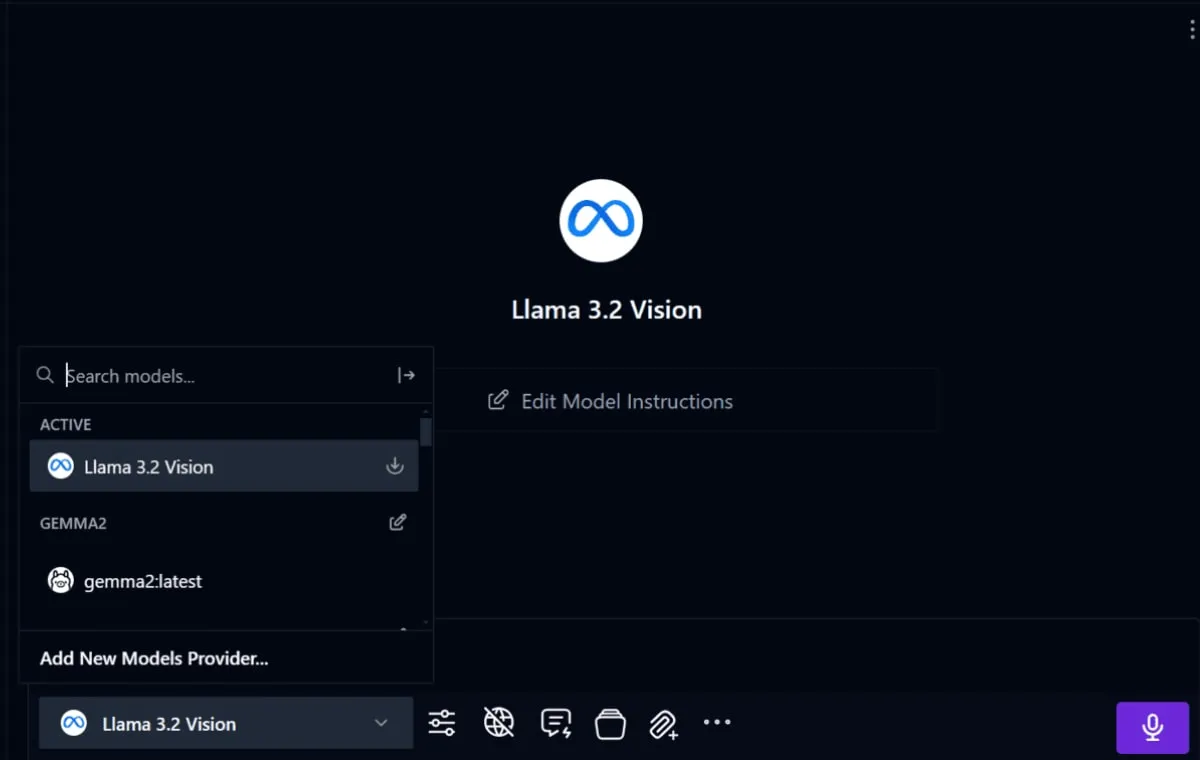

دانلود هوش مصنوعی لاما

اگر میخواهید از لاما روی لپتاپ خود و بدون نیاز به اینترنت استفاده کنید، میتوانید آن را روی دستگاه خود نصب کنید. برای دانلود هوش مصنوعی لاما باید چند مرحله را طی کنید. باید در ابتدا Llama 2 Web GUI را دانلود و نصب کنید. پس از نصب شما میتوانید به Llama 2 Web GUI دسترسی پیدا کرده و از طریق مرورگر خود آن را اجرا کنید. در ادامه اگر میخواهید از امکانات مدل زبانی Llama 2 هم استفاده کنید، باید آن را هم دانلود کرده و بارگذاری کنید. مراحل نصب هوش مصنوعی لاما بسته به نوع سیستم عامل شما که ویندوز، لینوکس یا مک باشد، متفاوت است.

Llama 3 چگونه کار میکند و چه تفاوتی با Llama 2 دارد؟

مدلهای Llama 3 برای ایجاد شبکه عصبی خود، با بیش از ۱۵ تریلیون «توکن» آموزش دیدهاند، که کل مجموعه دادهها هفت برابر بزرگتر از دادههایی است که برای آموزش Llama 2 استفاده شده است. برخی از دادهها از منابع عمومی مانند Common Crawl (آرشیوی از میلیاردها صفحه وب)، ویکیپدیا و کتابهای عمومی از پروژه گوتنبرگ به دست آمده است، در حالی که برخی دیگر نیز «دادههای مصنوعی» تولید شده توسط مدلهای قبلی AI بودند. (هیچکدام از آنها دادههای کاربران متا نیستند.)

هر توکن یک کلمه یا بخش معنایی است که به مدل اجازه میدهد معنی متن را تخصیص دهد و بهطور محتمل متن بعدی را پیشبینی کند. برای مثال اگر کلمات «سیب» و «آیفون» به طور مداوم با هم ظاهر شوند، این مدل قادر است درک کند که این دو مفهوم مرتبط هستند و از «سیب»، «موز» و «میوه» متمایزند. به گفته متا، توکنساز Llama 3 دارای دایره واژگان بزرگتری نسبت به Llama 2 است، بنابراین بهطور قابل توجهی کارآمدتر است.

البته، آموزش یک مدل AI بر روی اینترنت به صورت متن باز، خطراتی هم دارد و راه را برای آموزش مباحثی مانند نژادپرستی و محتواهای وحشتناک دیگر باز میگذارد، بنابراین توسعهدهندگان همچنین از استراتژیهای آموزشی دیگری، از جمله یادگیری تقویتی با بازخورد انسانی (RLHF)، برای بهینهسازی مدل برای پاسخهای ایمن و مفید استفاده کردهاند. با RLHF، تستکنندگان انسانی پاسخهای مختلف مدل AI را رتبهبندی میکنند تا آن را به سمت تولید خروجیهای مناسبتر هدایت کنند. نسخههای instruct نیز با دادههای خاصی تنظیم شدهاند تا آنها را در پاسخ به دستورالعملهای انسانی بهطور طبیعی بهتر کنند.

ویژگیهای جدید Llama 3

متا برای افزودن قابلیت بصری به مدلهای جدید خود، سیستم تصویری را بهطور جداگانه آموزش داده است تا آن را با مدلهای زبانی موجود هماهنگ کند. این بدان معناست که مدلهای Llama 3.2 11B-Vision و Llama 3.2 90B-Vision از نظر متن مشابه مدلهای موجود Llama 3.1 8B و Llama 3.1 70B هستند، اما همچنین میتوانند ورودیهای تصویری را بپذیرند. این یک سیستم هوشمند است چون هر کسی که قبلاً از لاما در برنامه خود استفاده کرده باشد، دیگر نیازی به استفاده از یک مدل زبانی اساسا جدید ندارد.

متا همچنین لاما گارد، پرامپت گارد و لاما کد شیلد، سه مدل ایمنی طراحی شده برای جلوگیری از اجرای پرامپتهای مضر یا تولید کد کامپیوتری ناامن توسط مدلهای لاما را هم توسعه داده است. اما همه این مدلهای لاما تنها به عنوان پایهای برای توسعهدهندگان طراحی شدهاند. اگر میخواهید یک LLM برای تولید خلاصه مقالات به سبک یا صدای خاص برند شرکت خود ایجاد کنید، میتوانید مدلهای لاما را با دهها، صدها یا حتی هزاران مثال آموزش دهید و یک نمونه برای خودتان بسازید که دقیقاً این کارها را برایتان انجام دهد.

بهطور مشابه، میتوانید یکی از مدلهای instruct را پیکربندی کنید تا به درخواستهای پشتیبانی مشتری شما، با ارائه سوالات متداول و اطلاعات مرتبط دیگر مانند گزارشهای چت پاسخ دهد. شما همچنین میتوانید هر مدل لاما را بگیرید و آن را دوباره آموزش دهید تا LLM کاملاً مستقلی برای خود ایجاد کنید. متا بهطور فزایندهای ابزارهایی برای تسهیل این کار ایجاد میکند. متا در کنار مدلهای لاما ۳.۲، از لاما استک که، مجموعهای از ابزارها و APIها برای آسانتر کردن توسعه برنامههای AI با لاما است هم رونمایی کرده است.

مقایسه لاما با GPT، جمینای و سایر مدلهای AI

در مقاله تحقیقاتی لاما ۳، محققان متا عملکرد مدلهای مختلف را در بنچمارکهای مختلف (مانند درک زبان چندوظیفهای و آزمون منطق معمولی (ARC-challenge) با تعدادی از مدلهای معادل باز و اختصاصی مقایسه میکنند. مدل ۸B با Mistral 7B و Gemma 2 9B مقایسه میشود، در حالی که مدل ۷۰B با GPT-3.5-Turbo و Mixtral 8x22B مقایسه میشود. در مقایسه مدلهای کوچکتر لاما همگی بهترین عملکردها را دارند، با این حال، مدلهای لاما با مدلهای مشابه در اندازه مشابه رقابت میکنند؛ یعنی مدل ۷B هرگز نمیتواند یک مدل با ۷۰ میلیارد پارامتر را شکست دهد، اما عملکرد آن قابل مقایسه با سایر مدلهای کوچک است.

جالبتر اینکه، مدل ۴۰۵B با GPT-4، GPT-4o و Claude 3.5 Sonnet مقایسه میشود. در حالی که این مدل بهترین عملکرد را ندارد، اما با مدلهای اختصاصی پیشرفته فعلی (به جز OpenAI o1) در رقابت است و در ارزیابیهای انسانی در برابر هم عملکرد خوبی داشته است و متا آن را «بزرگترین و تواناترین مدل بنیاد باز در جهان» مینامد، که به نظر میرسد ارزیابی عادلانهای باشد.

وضعیت مشابهی برای مدلهای لاما ۳.۲ وجود دارد. مدلهای سبک ۱B و ۳B به خوبی با مدلهای Gemma 2B و Phi-3.5 mini مقایسه میشوند، در حالی که مدلهای ۱۱B و ۹۰B که قابلیت بصری دارند، مشابه Claude 3 Haiku و GPT-4o mini عمل میکنند.

در آزمایشهای وبسایتهای مختلف، بهطور مداوم مدلهای لاما ۳ یک گام بزرگ رو به جلو در قیاس با لاما ۲ برداشتهاند. در حالی که متا AI هنوز برای خیلیها جایگزین ChatGPT نیست، اما مدلهای اصلی آن از بهترینهای جهان هستند و قطعاً از بهترین مدلهایی هستند که میتوانید هماکنون از Hugging Face دانلود کنید.

چرا هوش مصنوعی لاما اهمیت دارد؟

بیشتر LLMهایی که شما نام آنها را شنیدهاید، o1 و GPT-4o از اوپنای، جمینای از گوگل، کلاود از آنتروپیک هستند که همگی شکلی اختصاصی دارند و دسترسی به کد آنها برای کاربران در سطح اینترنت بسته است. محققان و فعالان حوزه کسبوکارها میتوانند از APIهای رسمی برای دسترسی به آنها استفاده کنند و حتی نسخههای تنظیمشده مدلهای خود را بهگونهای که پاسخهای سفارشی دهند، تنظیم کنند، اما واقعاً نمیتوانند بفهمند که درون آنها چه خبر است.

اما با لاما، شما میتوانید مدل را همین حالا دانلود کنید و به شرطی که مهارتهای فنی لازم را داشته باشید، آن را روی کامپیوتر خود اجرا کنید یا حتی به کد آن دسترسی پیدا کنید. (البته باید بدانید حتی LLMهای کوچک نیز به گیگابایت اندازهگیری میشوند و این نکته را در مورد ویژگیهای سیستمی که دارید لاما را روی آن نصب میکنید در نظر داشته باشید.) اگر میخواهید در مورد تفاوتهای لاما با دیگر هوشهای مصنوعی بیشتر بدانید، متا یک مقاله تحقیقاتی بزرگ منتشر کرده است که جزئیات نحوه آموزش کامل «گله لاما ۳» (Llama 3 herd)، معماری مورد استفاده، نحوه مقایسه آن با سایر مدلها، مراحل متا برای ایمنسازی آنها و جزئیات جذاب دیگر را توضیح میدهد.

آینده هوش مصنوعی لاما

شما میتوانید لاما را بر روی Microsoft Azure، Google Cloud، Amazon Web Services و سایر زیرساختهای ابری اجرا کنید تا بتوانید برنامه خود را که از LLM بهره میبرد، راهاندازی کنید یا آن را بر روی دادههای خود آموزش دهید تا نوع متنی که نیاز دارید را برایتان تولید کند. با این حال، با ادامه دادن به این سیستم اوپن سورس در لاما، متا بهطور قابل توجهی توسعه برنامههای AI را برای سایر شرکتها آسانتر میکند که کنترل بیشتری بر آنها داشته باشند، به شرطی که به سیاست استفاده قابل قبول از آن پایبند باشند.

تنها محدودیتهای بزرگ دیگر مجوزهایی است که لاما ارائه میدهد. شرکتهایی با بیش از ۷۰۰ میلیون کاربر ماهانه باید برای استفاده از لاما مجوز ویژهای درخواست کنند، بنابراین شرکتهایی مانند اپل، گوگل و آمازون باید مدلهای LLM خود را توسعه دهند.

مارک زاکربرگ و ربات لاما ساخته شده با میدجرنی

مارک زاکربرگ و آینده لاما

در نامهای که به همراه انتشار لاما ۳.۱ آمده است، مارک زاکربرگ، CEO متا، بهطور فوقالعادهای درباره برنامههای متا برای حفظ لاما بهصورت باز شفاف سازی کرده است:

«من معتقدم که استفاده اوپن سورس یا متن باز برای آینده AI ضروری است. AI پتانسیل بیشتری نسبت به هر فناوری مدرن دیگری برای افزایش بهرهوری، خلاقیت و کیفیت زندگی انسانی دارد و همچنین میتواند برای تسریع رشد اقتصادی و به تبع آن پیشرفت در تحقیقات پزشکی و علمی به کار گرفته شود. یک هوش مصنوعی متن باز موجب میشود که افراد بیشتری در سراسر جهان از مزایا و فرصتهایی که هوش مصنوعی فراهم میآورد، بهره ببرند و قدرت در دستان تعداد کمی از شرکتها متمرکز نمیشود. این فناوری همچنین میتواند بهطور یکنواخت و ایمن در سراسر جامعه به کار گرفته شود.»

بسیاری از پیشرفتهای بزرگ در محاسبات در ۷۰ سال گذشته بر اساس تحقیقات و تستهای متن باز ساخته شدهاند و حالا به نظر میرسد هوش مصنوعی هم یکی از آنها باشد. در حالی که به نظر میرسد گوگل، اپن ای آی و آنتروپیک همیشه در این فضای هوش مصنوعی نقشی کلیدی خواهند داشت، با این حال نمیتوانند برای همیشه با سیستم متن بسته کار کنند.

منبع: Zapier