نحوهی یادگیری هوش مصنوعی مشابه با عملکرد مغز ماست!

پس از یک دهه پیشرفت چشمگیر در تکامل هوش مصنوعی، امروزه بسیاری از این سیستمها با استفاده از پایگاه عظیمی از دادههای مختلف تبدیل به موجوداتی هوشمندتر شدهاند. به عنوان مثال، شبکهی عصبی مصنوعی این قابلیت را دارد که آموزش ببیند و بتواند بین تصویر گربهی پلنگی و پلنگ تمایز قائل شود و به خوبی تصویر پلنگ را از هر تصویر مشابهی تشخیص دهند. در عین حال لازم است بدانید که با اینکه تا به امروز این استراتژی به طور چشمگیری موفق بوده است، اما با مشکلات و ناکارآمدیهایی همراه است!

درواقع چنین آموزشهایی همواره با دادههایی که توسط انسان برچسبگذاری شده است، همراه شده است؛ به این معنی که شبکههای عصبی مصنوعی اغلب از میانبرهایی برای یادگیری استفاده میکنند! به عنوان مثال، یک شبکه عصبی مصنوعی ممکن است از حضور علف برای تشخیص عکس یک گاو استفاده کند، چراکه گاوها معمولاً در مزرعه عکس میگیرند. درواقع این دو المان، حاوی حداقل دادههایی هستند که به هوش مصنوعی در تشخیص کمک میکند! در همین راستا الکسی افروس «Alexei Efros»، دانشمند علم کامپیوتر در دانشگاه کالیفرنیا اذعان دارد که ما در حال پرورش نسلی از الگوریتمها هستیم که شبیه به دانشآموزانی رفتار میکند که در تمام ترم به کلاس نرفتهاند و مطالعهای نکردهاند، سپس در شب امتحان با انبوهی از اطلاعات روبهرو میشوند و تنها آنها را حفظ میکنند! در چنین حالتی دانشآموز به معنی واقعی کلمه مطالب را یاد نمیگیرد، اما در امتحان عملکرد خوبی دارد!

یادگیری تحتنظارت در مقایسه با یادگیری خودنظارتی

آیا مغز بیولوژیکی با یادگیری خودنظارتی «self-supervised learning» در ارتباط است؟

پاسخ به ابهامات مغز انسان با درک یادگیری در هوش مصنوعی

کاستیهای یادگیری خودنظارتی در توضیح عملکرد مغز ما

سخن پایانی

یادگیری تحتنظارت در مقایسه با یادگیری خودنظارتی

وجه اشتراک هوش حیوانات و ماشین برای بسیاری از محققان جالبتوجه است، چرا که رویهی یادگیری تحت نظارت موجودی دیگر «supervised learning» در زمان کندوکاو بر روی مغزهای بیولوژیکی بسیار محدود است. به طور کلی حیوانات (از جمله حیوان ناطقی همچون انسان) همچون ماشین از مجموعه دادههای برچسبگذاری شده، برای یادگیری استفاده نمیکنند. درواقع در بیشتر موارد، حیوان به تنهایی محیط را کاوش میکند و با انجام این کار درک غنی و قوی از جهان به دست میآورد.

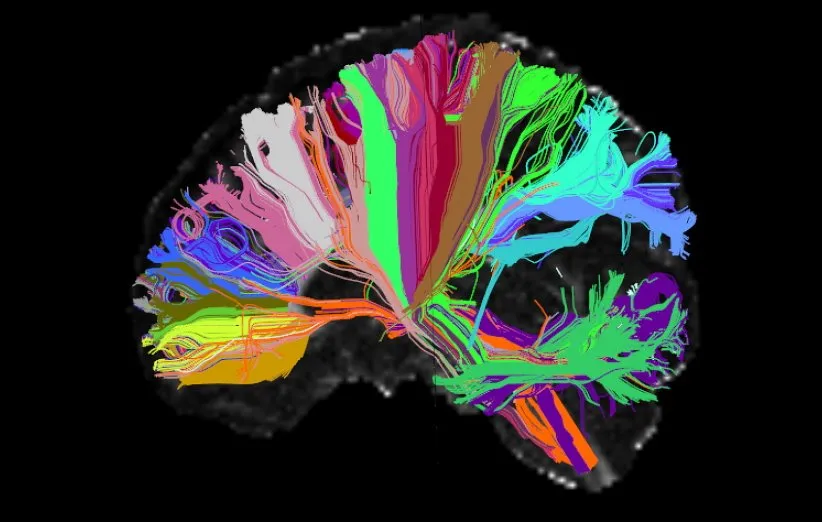

اکنون برخی از دانشمندان علوم اعصاب محاسباتی «computational neuroscientists» شروع به کاوش در شبکههای عصبیای از نوع آموزش دیده هستند که با دادههای کم یا بدون برچسب انسانی همراه است و به عنوان الگوریتمهای یادگیری خودنظارتی «self-supervised learning» شناخته میشوند. جالب است بدانید که این الگوریتمهای یادگیری خودنظارتی «self-supervised learning» تا به امروز در مدلسازی زبان انسان و عملیات تشخیص تصاویر بسیار موفق بوده است. طی مطالعات و تلاشهای اخیر، مدلهای محاسباتیای از سیستم بینایی و شنوایی پستانداران با استفاده از مدلهای یادگیری خودنظارتی ساخته شد که مطابقتی نزدیک و قابلتوجهی به عملکرد مغز نسبت به مواردی با یادگیری تحت نظارت انسان را نشان میداد! بنابراین برخی از دانشمندان علوم اعصاب اذعان دارند که شبکههای مصنوعی شروع به افشای برخی از روشهای مغز ما برای یادگیری کردهاند.

یادگیری خودنظارتی (self-supervised learning) به شبکهی عصبی اجازه میدهد تا خودش بفهمد که چه چیزی مهم و چه چیزی بیاهمیت است؛ در همین راستا این فرآیند ممکن است همان چیزی باشد که مغز ما را بسیار موفق کرده است!

آیا مغز بیولوژیکی با یادگیری خودنظارتی «self-supervised learning» در ارتباط است؟

ساخت مدلهای مغزی با الهام از شبکههای عصبی مصنوعی در حدود 10 سال پیش آغاز شد و ساخت آنها تقریباً با زمان ظهور شبکههای عصبیای به نام الکسنت «AlexNet» که طبقهبندی تصاویر نامشخص را متحول کرده است، همزمان بوده است. این شبکه، مانند همهی شبکههای عصبی، از لایههایی از نورونهای مصنوعی ساخته شده است که واحدهای محاسباتی آن از اتصالاتی به یکدیگر برخورداراند و میتوانند از نظر قدرت یا وزن «weight» متفاوت باشند.

وزنِ سیناپسی «Synaptic weight» به معنی قدرت یا دامنهی اتصال بین دو گره در شبکهی نورونی است.

اگر یک شبکه عصبی نتواند یک تصویر را به درستی طبقهبندی کند، الگوریتم یادگیری، وزن اتصالات بین نورونها را بازبینی و بهروز میکند تا احتمال اشتباهِ طبقهبندی را در دور بعدی آموزش کمتر کند. طی این رویه، الگوریتم این فرآیند را بارها و بارها با تمام تصاویر تمرینی تکرار میکند، تا زمانی که میزان خطای شبکه به طور قابل قبولی کم شود! تقریباً در همان زمان، عصبشناسان اولین مدلهای محاسباتی سیستم بینایی نخستیها « primate visual system» را با استفاده از شبکههای عصبیای همچون AlexNet و نمونههای مشابه آن توسعه دادند. چنین رویهای موفق عمل کرد، چراکه به عنوان مثال، زمانی که به میمونها و شبکههای عصبی مصنوعی، تصاویر مشابهی را نشان دادند، فعالیت نورونهای واقعی و نورونهای مصنوعی مطابقت جالبی را نشان دادند! چنین نتیجهای در مدلهای مصنوعی شنوایی و بویایی هم با موفقیت دنبال شد!

یکی از آزمایشات موفق در زمینهی فهم هوش مصنوعی، استفاده از مدلهای محاسباتی سیستم بینایی نخستیها با استفاده از مدلهای یادگیری خودنظارتی است. در طی این فرآیند با نمایش تصاویر مختلف به میمونها و هوش مصنوعی، فعالیت نورونهای واقعی و نورونهای مصنوعی مطابقت جالبی را نشان دادند!

با پیشرفت در این زمینه، محققان خیلی زود متوجه محدودیتهای یادگیری تحت نظارت شدند. به عنوان مثال، در سال 2017، لئون گاتیس «Leon Gatys»، دانشمند کامپیوتر در دانشگاه توبینگن در آلمان و همکارانش تصویری از یک فورد مدل T را انتخاب کردند و سپس پوششی همچون پوست پلنگ را روی عکس آن کشیدند و تصویری عجیب اما به راحتی قابل تشخیص را ایجاد کردند! یک شبکه عصبی مصنوعی پیشرفته به درستی تصویر اصلی را به عنوان فورد مدل T طبقهبندی میکند، اما تصویر پوشیده شده با پوست پلنگی را پلنگ در نظر میگرفت! درواقع شبکهی عصبی مصنوعی بر پایهی یادگیری تحت نظارت، هیچ درک درستی از شکل ماشین (یا پلنگ) ندارد و تنها قضاوت خود را به بافت محدود میکند!

حال با توجه به این آزمایش میتوانید به راحتی درک کنید که چرا راهبردهای یادگیری خودنظارتی «Self-supervised learning» جایگزین یادگیری تحت نظارت « Supervised learning» شده است. در این رویکرد، انسان ها دادهها را برچسبگذاری نمیکنند و برچسبها و ماهیت هر چیزی از خود آن دادهها میآید. جالب است بدانید که الگوریتمهای خودنظارتی اساساً میتوانند شکافهایی در دادهها ایجاد کنند و از شبکهی عصبی بخواهند تا جاهای خالی را پر کند. به عنوان مثال، در یکی از تمرینها، الگوریتم یادگیری چند کلمه اول از یک جمله را به شبکه عصبی مصنوعی نشان میدهد و از آن میخواهد که کلمهی بعدی را پیشبینی کند. در چنین حالتی به نظر میرسد، هنگامی که این مدل با مجموعهای عظیمی از متون جمع آوری شده از اینترنت آموزش میبیند، میتواند قواعد نحوی زبان را یاد بگیرد و توانایی زبانی چشمگیری (آن هم بدون نظارت و برچسبهای خارجی!) را نشان دهد.

حیوانات و انسانها به تنهایی محیط را کاوش میکند و با انجام این کار درک غنی و قوی از جهان به دست میآورد؛ بنابراین عملکر مغز ما به برچسبگذاریهای موجودی دیگر وابسته نیست و با یادگیری خودنظارتی همراه است.

تلاشهای مشابهی در زمینهی بینایی کامپیوتر هم در حال انجام است. به عنوان نمونه در اواخر سال 2021، کایمینگ هی «Kaiming He» و همکارانش روشی به نام (پوشاندن خودکار- رمزگذاری) «masked auto-encoder» را معرفی کردند، که مبتنی بر تکنیکی تیم افروس در سال 2016 است. الگوریتم یادگیری خود نظارتی بهطور تصادفی تقریباً سه چهارم از هر یک از تصاویر را پنهان میکند. سپس به روش پوشاندن خودکار- رمزگذاری، بخشهای غیر پنهان تصویر را به نمایشی نهفته تبدیل میکند که نمایشی ریاضیاتی و فشرده و حاوی اطلاعات مهمی درباره آن شی است؛ پس از این مرحله یک رمزگشا آن تصاویر را دوباره به تصاویر کامل تبدیل میکند.

الگوریتم یادگیری خودنظارتی، ترکیبی رمزگذار-رمزگشا را به ماشین آموزش میدهد تا تصاویری با بخشهای پنهان را به نسخههای کاملی از تصویر اولیهی خود تبدیل کند. در این میان هر گونه تفاوت بین تصاویر واقعی و تصاویر بازسازی شده به سیستم بازگردانده میشود تا به یادگیری آن کمک کند. درواقع این فرآیند برای مجموعهای از تصاویر آموزشی آنقدر تکرار میشود تا زمانی که میزان خطای سیستم به طور مناسبی کم شود. به عنوان نمونه، زمانی که به سیستم آموزشدیدهی پوشاندن خودکار- رمزگذاری، تصویری از یک اتوبوس (در حالی که تا به حال چنین چیزی را ندیده بود!) با پوشش تقریباً 80 درصدی بخشهای مختلف آن نشان داده شد، سیستم با موفقیت ساختار اتوبوس را بازسازی کرد. این نتیجه به طرز چشمگیری بسیار مهم و باارزش است.

بلیک ریچاردز عصبشناس محاسباتی اذعان دارد که 90 درصد از کارهایی که مغز ما قادر به انجام آن است از یادگیری خودنظارتی نشات میگیرد.

بنابراین به نظر میرسد که بازسازیهای بخشهای نهفته حاوی اطلاعات عمیقتری نسبت به استراتژیهای قبلی است. در چنین حالتی این سیستم ممکن است نه فقط بافتها، بلکه شکل (ماشین، پلنگ و …) را هم درک کند. درواقع میتوان اذعان داشت که این موضوع ایدهی بنیادی یادگیری خودنظارتی است؛ به این شکل که شما دانش و درک خود از مفاهیم را از پایه به بالا میسازید (مانند دانشآموزی که در طول ترم درس میخواند و مفاهیم را درک میکند!)، بدون اینکه برای قبولی در آزمونهای نهایی سختگیری زیادی را (یک شبه) اعمال کند.

پاسخ به ابهامات مغز انسان با درک یادگیری در هوش مصنوعی

در سیستمهایی مشابه با آنچه معرفی شد، برخی از عصبشناسان پژواکهایی از نحوهی یادگیری ما را مشاهده میکنند. بلیک ریچاردز (Blake Richards)، عصبشناس محاسباتی در دانشگاه مکگیل و میلا اذعان دارد که 90 درصد از کارهایی که مغز ما قار به انجام آن است از یادگیری خودنظارتی نشات میگیرد. در حالت کلی تصور میشود که مغزهای بیولوژیکی به طور مداوم مکان آیندهی یک شیء در حال حرکت یا کلمه بعدی در یک جمله را پیشبینی میکنند، درست همانطور که یک الگوریتم یادگیری خودنظارتی تلاش میکند تا بخش مبهم یک تصویر یا بخشی از متن را پیشبینی کند؛ بنابراین مغزها (چه بیولوژیکی و چه مصنوعی) به تنهایی از اشتباهات خود یاد میگیرند!

به منظور آشنایی درک بهتر شباهتهای مغز ما با شبکهی عصبی مصنوعی، سیستم بینایی انسان و دیگر نخستیها را در نظر بگیرید. سیستمهای بینایی بهترین سیستمهای حسی در بین این دسته از حیوانات است، اما وجود دو مسیر اصلی و مجزا در سیستم بینایی همواره برای دانشمندان علوم اعصاب جای سوال داشته است. یکی از این مسیرها، جریان بینایی شکمی «ventral visual stream» است که مسئول تشخیص اشیا و چهرهها به حساب میآید و دیگری جریان بینایی پشتی «dorsal visual stream» است که حرکات را پردازش میکند. با توجه به همین سوال هم ریچاردز و تیمش با استفاده از یک مدل خودنظارتی جرقهای برای پاسخ به این سوال ساختند.

برای این کار این تیم تحقیقاتی هوش مصنوعی را آموزش دادند تا دو شبکهی عصبی مختلف را با هم ترکیب کند، یکی از این شبکهها معماری ResNet نام داشت برای پردازش تصاویر طراحی شده بود و دیگری به عنوان شبکهی بازگشتی «Recurrent network» شناخته میشد و میتوانست دنبالهای از ورودیهای قبلی را به منظور پیشبینی ورودی مورد انتظار بعدی پیگیری کند.

به منظور آموزش هوش مصنوعی ترکیبی، تیم با دنبالهای (مثلاً 10 فریم) از یک ویدیو شروع کردند و به شبکهی ResNet اجازه دادند تا آنها را یکی یکی پردازش کند. سپس شبکه بازگشتی نمایش فریم یازدهم را که نهفته بود پیشبینی کرد، این در حالی بود که فریم یازدهم به سادگی با 10 فریم اول مطابقت نداشت. سپس الگوریتم یادگیری خودنظارتی، مقادیر پیشبینی شده را با مقادیر واقعی مقایسه کرد و طی بررسی میزان خطا به شبکههای عصبی دستور داد تا وزنهای خود را بهروزرسانی کنند تا پیشبینیهای بهتری انجام شود. در همین راستا جالب است بدانید که تیم ریچاردز دریافتند که هوش مصنوعی آموزشدیده با شبکهی ResNet در تشخیص اشیا خوب عمل میکند، اما در دستهبندی حرکات چندان بهینه نیست. این در حالی است که اگر ResNet را به دو بخش مجزا تقسیم کنند و دو مسیر (بدون تغییر تعداد کل نورونها) بسازند، هوش مصنوعی نمایشی از اشیاء را در یک مسیر و حرکت را در مسیر دیگری ایجاد میکند و امکان طبقهبندی بهتر آن (درست همانطور که احتمالاً مغز ما انجام میدهد)، ایجاد خواهد شد.

وجود دو مسیر اصلی و مجزا در سیستم بینایی موجوات مختلف یکی از سوالات مهم عصبشناسان است که تا حدی با درک و آزمایش هوش مصنوعی ترکیبی به آن پاسخ داده میشود!

کاستیهای یادگیری خودنظارتی در توضیح عملکرد مغز ما

جاش مک درموت (Josh McDermott)، عصبشناس محاسباتی در موسسه فناوری ماساچوست، یکی از کسانی است که روی مدلهای بینایی و ادراک شنوایی با استفاده از یادگیری تحتنظارت و خودنظارتی کار کرده است و از جمله محققینی است که چندان با این نظریه موافق نیست. او در آزمایشگاه خود چیزی به نام متامرها «metamers» را طراحی کرده است که به نوعی سیگنالهای صوتی و بصریای به حساب میآیند که برای انسان به شکلی نویز مانند و غیرقابل درک است. با این حال، برای یک شبکهی عصبی مصنوعی، متامرها از سیگنالهای واقعی قابل تشخیص نیستند. بنابراین این آزمایش نشان میدهد که نمایشهایی که در لایههای عمیقتر شبکه عصبی شکل میگیرند، حتی با یادگیری خودنظارتی، با نمایشهای مغز ما مطابقت ندارند.

از نظر مک درموت، این رویکردهای یادگیری خودنظارتی پیشرفتهایی به منظور یادگیری یکسری نمایشها است که میتواند بسیاری از رفتارهای شناختی را بدون نیاز به برچسبهای یک ناظر پشتیبانی کند؛ اما همچنان با مشکلات عمیقی درگیر است. از طرفی خود الگوریتمها هم نیازمند به کار بیشتری دارند. به عنوان مثال، «Meta AI’s Wav2Vec 2.0»، از جمله مواردی است که تنها قابلیت پیشبینی بخشهای نهفته را برای صدایی چند ده میلیثانیهای دارد که کمتر از زمان لازم برای درک یک نویز آن هم به شکلی قابل تمایز است و حتی به ادراک یک کلمه هم نمیرسد!

سخن پایانی

درک واقعی عملکرد مغز به چیزی بیش از یادگیری تحتنظارت نیاز دارد؛ چراکه مغز مملو از اتصالات بازخوردی است، در حالی که مدلهای فعلی (اگر وجود داشته باشند)، چنین ارتباط گستردهای ندارند و تنها شامل گرههای ارتباطی اندک میشوند. از طرفی گام بعدی در درک بهتر مغز و هوش مصنوعی استفاده از یادگیری خود نظارتی برای آموزش شبکههای برگشتی و مشاهدهی چگونگی فعالیت چنین شبکههایی در مقایسه با فعالیت واقعی مغز است. گام مهم دیگر تطبیق فعالیت نورونهای مصنوعی در مدلهای یادگیری خودنظارتی با فعالیت نورونهای بیولوژیکی افراد خواهد بود. البته در همین راستا لازم به ذکر است که اگر شباهتهای مشاهده شده بین مغز و مدلهای یادگیری خودنظارتی برای سایر سیستمهای حسی هم وجود داشته باشد، میتوان دلیل محکمی برای این موضوع باشد که هر کاری مغز ما قادر به انجام آن است، به نوعی به یادگیری خودنظارتی نیاز دارد.

منبع: Quanta MAGAZIN

چه قدر پیچیده بود!

این دانشمندان چه کارهایی می کنند!