هوش مصنوعی چطور عکاسی را تغییر داده است؟

اگر میخواهید بدانید که چقدر دوربین گوشی بعدی شما خوب خواهد بود، باید به دقت گوش بدهید ببینید شرکت سازنده آن، چه چیزی درباره هوش مصنوعی میگوید. جدا از سر و صدای اغراق آمیز و زیادی که درباره هوش مصنوعی شنیده میشود، این تکنولوژی در نهایت توانسته در یکی دو سال اخیر، عکاسی در موبایلها را تا حد زیادی بهبود ببخشد. اگر فکر میکنید ترکیب هوش مصنوعی و دوربین موبایلها یک ترند زودگذر است و به زودی فراموش میشود، بگذارید بگوییم که حالا حالاها باید شاهد پیشرفت ترکیب این دو باشیم.

البته که هنوز موارد اضافی و بدون استفاده زیادی در این زمینه وجود دارد. اما پیشرفتهای اخیر در دوربین موبایلها بیش از آن که به لنز و سنسور مربوط باشد، به چیپست پردازش تصاویر و همچنین نرمافزار دوربینها مربوط بوده است. بخش زیادی از این پیشرفت را هم مدیون هوش مصنوعی یا همان AI هستیم که به دوربین این امکان را میدهد که صحنه در حال شکار را بهتر بشناسد.

اپلیکیشن گوگل فوتوز که در سال ۲۰۱۵ منتشر شد، به خوبی نشان داد که چقدر ترکیب هوش مصنوعی و عکاسی، میتواند قدرتمند و در عین حال کاربردی باشد. قبل از دوران گوگل فوتوز، این غول دنیای جستوجو، یادگیری ماشینی در شبکه اجتماعی گوگل پلاس استفاده میکرد تا بتواند ویژگی تشخیص چهره در عکسها را بخبود ببخشد. سپس با انتشار اپلیکیشن گوگل فوتوز، گوگل توانست با کمک فناوری تشخیص چهره بر پایه AI، امکان جستوجو بین عکسهای گالری را برای کاربران به ارمغان آورد. هزاران عکسی که نه تگ داشتند و نه مرتب شده بودند، یک شبه قابل جستوجو شدند که امکانی فوق العاده بود.

و حالا این تکنولوژی آنقدر پیشرفت کرده که فناوری تشخیص چهره گوگل، میتواند چهره گربه شما را هم تشخیص بدهد.

پیشرفتهای گوگل در این زمینه، از سال ۲۰۱۳ آغاز شد. در این سال، گوگل شرکت DNNresearch که یک شبکه عصبی عمیق آموزش داده شده توسط انسان را ساخته بود، خریداری کرد. به تکنولوژی توسعه داده توسط این شرکت، به طور خلاصه «یادگیری تحت نظارت» میگویند. یادگیری تحت نظارت شامل شبکهای از میلیونها تصویر میشود که در آن سیستم به دنبال سرنخهای بصری در سطح پیکسلها میگردد تا بتواند هر عکس را در دستهبندی خودش، جای بدهد. به مرور زمان، الگوریتم این تکنولوژی بهتر شده و پیشرفت میکند و مثلا میتواند یک پاندا را تشخیص دهد؛ چراکه در گذشته تصاویر زیادی از پاندا دریافت و شناسایی کرده و حالا مشکلی در شناسایی یک پاندای جدید، ندارد. سیستم برای تشخیص پاندا، یادگرفته که کجا پوست خز مشکی و کجا پوست خز سفید پاندا قرار میگیرد و ارتباط بین دو بخش سیاه و سفید پاندا را از ارتباط بین بخشهای سیاه و سفید یک گاو نژاد هلشتاین، تشخیص میدهد. با تمرین دادن بیشتر این سیستم، امکان جستجو برای موارد انتزاعی بیشتری مثل «حیوان» یا «صبحانه» به وجود آمده که ممکن است شاخصهای بصری مشترکی نداشته باشند اما همچنان برای انسان، به سرعت قابل تشخیص است.

زمان و قدرت پردازشی زیادی برای تمرین دادن و به وجود آوردن چنین الگوریتمی نیاز است. زمانی که دیتا سنترهای بزرگ توانستند نقش خود را برای تمرین دادن این الگوریتم به خوبی ایفا کنند، نوبت به موبایلهای هوشمند میرسد تا با قدرت پردازشی کمترشان، بتوانند به گسترش این الگوریتم کمک کنند. بخش بزرگ کار پیش از عرضه این سیستم روی موبایلها انجام شده و حالا به محضی که عکسهای شما در سرورهای ابری گوگل آپلود شوند، گوگل میتواند از این اطلاعاتی که در اختیارش میگذارید، برای بهبود این سیستم، استفاده کند. یک سال پس از عرضه گوگل فوتوز، اپل هم یک ویژگی جدید در گالری iOS قرار داد که به کاربران اجازه میداد در عکسها جستوجو کنند. تکنولوژی اپل نیز مثل گوگل بر پایه شبکه عصبی ساخته شده بود.

تفاوت اپل اینجا بود که اطلاعاتی از گوشی کاربران به جایی ارسال نمیشد و فرآیندهای مربوط به دسته بندی عکسها، روی گوشی کاربر انجام میشد. به همین دلیل، بین یک تا دو روز پس از عرضه و نصب بروزرسانی مربوط به این ویژگی، امکان استفاده از آن وجود نداشت چرا که گوشی در پس زمینه در حال دستهبندی این عکسها با تکیه بر هوش مصنوعی خود بود.

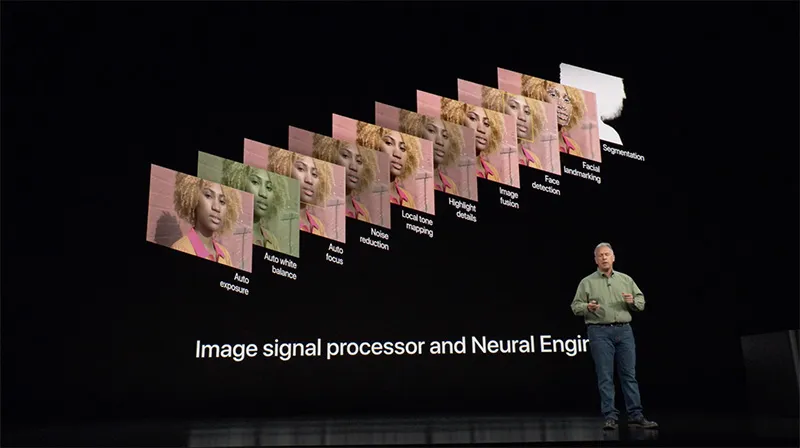

نرمافزار مدیریت هوشمند عکسها یک چیز است و هوش مصنوعی و یادگیری ماشینی چیز دیگر که در مرحله ثبت هر عکس به کار میآید. بله در سالهای اخیر، لنز دوربینهای موبایلی سریعتر شده و سنسورها نیز هرسال کمی بزرگتر میشوند اما میتوانیم بگوییم در حال حاضر به حد فیزیکی اندازه دوربینها رسیدهایم و اگر بخواهیم سنسورهای بزرگتری استفاده کنیم، با گوشیهایی ضخیمتر روبرو میشویم. با این وجود، عجیب نیست اگر برخی گوشیهای بتوانند از برخی دوربینها، عکسهای بهتری ثبت کنند؛ حداقل قبل از ادیت تصاویر. این موضوع به این دلیل است که دوربینهای حرفهای، هنوز نمیتوانند در یک ویژگی سختافزاری، با موبایلها رقابت کنند و آن، چیپست پردازشی دوربینها است. این چیپست شامل CPU، پردازشگر اختصاصی تصاویر و حالا واحد پردازش عصبی میشود.

این برتری سختافزاری، چیزی به اسم «عکاسی محاسباتی» را به موبایلاه میآورد. عکاسی محاسباتی طیف گستردهای از افکت بوکه مصنوعی در گوشیهای هوشمند گرفته تا کیفیت فوق العاده تصاویر ثبت شده توسط پیکسل ۳ را شامل میشود. عکاسی محاسباتی همیشه نیازمند هوش مصنوعی نیست اما هوش مصنوعی بخش مهمی از آن را تشکیل میدهد!

اپل از تکنولوژی عکاسی محاسباتی استفاده میکند تا با قرار دادن دو دوربین در گوشیهای خود، افکت عکاسی پرتره را برای کاربران فراهم آورد. چیپست پردازش تصاویر در آیفون از یادگیری ماشینی استفاده میکند تا بتواند افراد را در یک دوربین شناسایی کند و سپس دوربین دوم، یک نقشه از عمق میدان میسازد. در نهایت به کمک نقشه به وجود آمده از عمق میدان و جدا کردن فرد در تصویر، پسزمینه تصاویر بلور میشود و عکس پرتره ثبت میشود. این امکان که دوربین به کمک یادگیری ماشینی بتواند افراد را تشخیص دهد، چیز جدیدی نبود که اپل در سال ۲۰۱۶ معرفی کرده باشد اما اینکه دوربین گوشی میتوانست به صورت لحظهای این کار را انجام دهد و تصاویر پرتره را قبل از ثبت شدن نشان دهد، اتفاقی فوق العاده بود.

گوگل با سه نسل از گوشیهای پیکسل، اثبات کرده که در زمینه عکاسی محاسباتی در موبایلها، حرف اول را میزند. گوشیهای این شرکت به صورت پیشفرض، با حالت HDR+ عکاسی میکنند. این حالت با استفاده از یک الگوریتم پیچیده، برای ثبت هر عکس، چندین عکس با اکسپوژرهای مختلف را با هم ترکیب میکند تا عکسی فوق العاده ثبت شود. آنطور که مدیر بخش عکاسی محاسباتی در گوگل، آقای Marc Levoy، به وبسایت ورج گفته است، یادگیری ماشینی یعنی سیستم مدام در حال یادگرفتن است و به مرور زمان بهتر میشود. گوگل هوش مصنوعی خود را با توجه به دیتابیس بزرگی که توانسته با اپلیکیشن گوگل فوتوز به دست بیاورد، بهتر و بهتر کرده است. سال گذشته و گوشی پیکسل ۲ خیلی خوب توانست نتیجه تلاشهای گوگل در این زمینه را نشان بدهد و عکسهای ثبت شده با این گوشی آنقدر خوب بود که وبسایت ورج ترجیح میداد به جای استفاده از دوربین حرفهای، گاهی اوقات از پیکسل ۲ برای ثبت عکس از محصولات استفاده کند.

ویژگی Night Sight در پیکسل ۳، بهترین تبلیغ برای نقش نرمافزار در عکاسی است

اما برتری گوگل به اندازه چند ماه پیش که ویژگی Night Sight را معرفی کرد، مشهود نبود. پیکسلهای جدید به این ویژگی مجهز شدهاند که درواقع در شب، چند عکس با اکسپوژرهای مختلف ثبت میکند و سپس با بهره گیری از الگوریتمهای یادگیری ماشینی، میزان وایتبالانس و شدت رنگها را تعیین میکند و نتیجه، عکسی پر نور در شب خواهد بود. این ویژگی بهترین عملکرد خود را روی پیکسل ۳ دارد چرا که برای سختافزار این گوشی ساخته شده اما در نهایت گوگل این ویژگی را برای پیکسلهای قبلی هم با یک بروزرسانی نرمافزاری، عرضه کرد. حتی نسل اول پیکسل که حتی به لرزشگیر دوربین هم مجهز نیست، میتواند با نایت سایت عکسهایی فوق العاده در شب ثبت کند که بار دیگر نقش مهم و انکار نشدنی نرمافزار در عکاسی با موبایلها را نشان میدهد.

اما با این وجود، هنوز هم جا برای پیشرفت سختافزاری دوربینها وجود دارد؛ مخصوصا اگر با هوش مصنوعی نیز ترکیب شوند. بهترین نمونه از این حالت را میتوانیم گوشیهای آنر ویو ۲۰ و هواوی نووا ۴ بدانیم. این گوشیها، اولین مصحولاتی هستند که به سنسور IMX586 ساخت سونی مجهز شدهاند. این سنسور از دیگر رقبای خود در دنیای موبایلها، بزرگتر است و رزولوشن فوق العاده ۴۸ مگاپیکسلی دارد که بیشتری رزولوشن یک دوربین در یک موبایل است. اما همزمان سنسور ۴۸ مگاپیکسلی یعنی جای دادن پیکسلهای کوچکتر در سطح سنسور که به معنی دریافت نور کمتر و در نهایت یعنی به افت کیفیت عکاسی در شب میانجامد. اما صبر کنید؛ دوربین این گوشیها، حالت عکاسی در شب هم دارد که با تکنیک ترکیب پیکسلها، هر چهار پیکسل مجاور را تبدیل به یک پیکسل میکند و در نهایت عکسی ۱۲ مگاپیکسلی ثبت میکند که کیفیت بسیار خوبی دارد.

حالت AI Ultra Clarity در گوشی آنر ویو ۲۰ نیز از رزولوشن ۴۸ مگاپیکسلی دوربین ویو ۲۰ استفاده میکند تا عکسهایی با جزئیات بسیار بالا ثبت کند که میتوان تا حد زیادی هم در این عکسها زوم کرد.

تا همین چند وقت پیش، چیپستهای پردازش تصاویر نقش عمده در عکاسی با موبایلها داشتند اما حالا واحد پردازشی عصبی یا NPU که در پردازندههای امروزی قرار دارد، نقش اصلی را در عکاسی محاسباتی موبایلها، ایفا میکنند. هواوی اولین شرکتی بود که واحد پردازش عصبی را در چیپست موبایلی خود گذاشت و در گوشیهای میت ۱۰ و سری P20 شاهد آن بودیم. پس از هواوی، شرکت اپل بود که با چیپست A11 Bionic، واحد پردازش عصبی را به آیفونها آورد. کوالکام که بزرگترین تامین کننده پردازنده گوشیهای اندرویدی است، تا به امروز پردازندهای با واحد پردازش عصبی عرضه نکرده است. گوگل هم که متکی به پردازندههای کوالکام است، مجبور شده چیپست اختصاصی Pixel Visual Core را در گوشیهای خود بگنجاند تا با آن بتواند عکاسی محاسباتی را به پیکسلها بیاورد.

برای اینکه ببینید در یک سال اخیر چقدر واحد پردازش عصبی در پردازندهها اهمیت پیدا کرده، بگذارید بگوییم که آخرین پردازنده اپل یعنی A12 Bionic، از واحد پردازش عصبی هشت هستهای که وظایف را در Core ML انجام میدهد، تشکیل شده است. همین پردازنده در مجموع ۹ برابر سریعتر از A11 میتواند پردازشهای مربوط به هوش مصنوعی را انجام دهد و واحد پردازشی عصبی آن، مستقیما به چیپست پردازش تصاویر وصل شده است. از همین رو، اپل ادعا میکند که گوشیهای جدید این شرکت که A12 Bionic دارند، در عکاسی پرتره میتوانند عمق میدان را بهتر بفهمند و میزان بلور شدن عمق میدان در تصاویر پرتره، طبیعیتر خواهد بود.

دوربین بخش بسیار مهمی از هر گوشی به حساب میآید و هوش مصنوعی، بهترین راهکار برای بهبود آن است.

این نوع سختافزار، اهمیت زیادی برای عملکرد یادگیری ماشینی روی گوشیهای هوشمند دارد. فراموش نکنید که پیش از این، الگوریتمهای گوگل فوتوز روی کامپیوترهای فوق قدرتمند با پردازشگرهای گرافیکی فوق قدرتمند اجرا میشدند. حالا بخش زیادی از همان فعالیتها، میتواند روی گوشیهای هوشمند انجام شود چراکه واحد پردازش عصبی گوشیهای امروزی، بسیار قدرتمندتر از آن چیزی است که تصور میکنیم.

گوگل همچنین در حال توسعه تکنولوژی است که بتواند بار پردازش تصاویر را سبکتر کند و فشار کمتری به پردازندهها وارد شود اما در عین حال پردازندهها نیز سریعتر میشوند و آماده برای پردازشهای سنگینتر هستند. در نهایت ما هنوز در ابتدای مسیر عکاسی محاسباتی قرار داریم. یادگیری ماشینی به دوربین موبایلها جان تازهای بخشیده و پتانسیلهای زیادی در این زمینه وجود دارد. درواقع با وجود هیجانی که حول محور هوش مصنوعی و تاثیر آن در گوشیها وجود دارد، بیش از هرچیز دیگری، در زمینه عکاسی شاهد استفاده از هوش مصنوعی و کاربردهای آن هستیم. دوربین بخش بسیار مهمی از هر گوشی به حساب میآید و هوش مصنوعی، بهترین راهکار برای بهبود آن است.

منبع: TheVerge